Chaque jour, des millions de requêtes sont adressées à des modèles d’IA générative, souvent sans que leurs utilisateurs aient conscience de leur impact réel.

Derrière l’apparente légèreté d’un échange avec ChatGPT ou Gemini se cachent des infrastructures colossales, voraces en énergie et en eau. Face à une consommation qui pourrait être multipliée par huit d’ici 2030 selon le Shift Project, une question s’impose : peut-on utiliser l’IA autrement ?

C’est précisément l’ambition de l’IA frugale, une démarche qui va plus loin que le Green AI qui ne sacrifie pas la performance, mais qui la met au service du juste nécessaire.

Les impacts environnementaux de l’IA

Les impacts environnementaux de l’IA sont aujourd’hui bien connus, pourtant, les offres et les usages de l’IA ne cessent d’augmenter.

Pourquoi l’IA pollue-t-elle ?

Il y a une idée reçue qui a la vie dure et que nous combattons avec acharnement chez Consultis Environnement : l’intelligence artificielle serait une technologie immatérielle, à laquelle chacun pourrait décider de faire appel sans aucune conséquence énergétique ou environnementale.

Cette erreur de perception occulte une réalité dans laquelle chaque modèle d’IA générative est alimenté par des data centers de plus en plus gourmands en énergie. Ces centres de données hébergent des milliers de serveurs qui calculent, stockent et transmettent des volumes de données sans interruption.

Pour fonctionner, ces serveurs ont besoin de deux éléments :

- De l’électricité pour fonctionner, les puces graphiques (GPU) utilisées pour faire tourner les modèles d’IA en consomment jusqu’à quatre fois plus que les puces classiques

- De l’eau pour se refroidir et pour évacuer la chaleur dégagée par les composants, représentant parfois plusieurs millions de litres par jour pour un seul data center.

❓ Le saviez vous ?

Selon l’Agence Internationale de l’Energie (AIE), une interaction avec un modèle d’IA génératif consomme environ 10 fois plus d’énergie qu’une simple recherche sur Google

L’empreinte carbone de cette consommation électrique ne dépend pas uniquement des volumes en jeu, mais aussi de la manière dont cette électricité est produite. En effet, un data center alimenté par des centrales à charbon sera bien plus polluant qu’un data center raccordé à un réseau à majorité nucléaire, à consommation électrique égale.

Les usages de l’IA se multiplient

Pour analyser l’accroissement de la pollution générée par l’IA, il est essentiel de bien comprendre le phénomène de boucle « effets d’offre / effets d’usages ».

Qu’est-ce que la boucle effets d’offre / effets d’usages ?

D’un côté, des acteurs technologiques investissent des sommes mirobolantes pour construire de nouvelles infrastructures (notamment des data centers plus puissants ou des puces plus performantes). Ce qui a pour effet d’accroître l’offre disponible et la puissance des outils d’IA générative.

Ces nouvelles capacités ouvrent, de l’autre côté, des usages inédits et des fonctionnalités que personne n’imaginait quelques mois auparavant. Ces usages se démocratisent et deviennent rapidement incontournables dans les organisations comme dans la sphère privée. Ce surcroît de demande justifie alors de nouveaux investissements dans des infrastructures encore plus puissantes. La boucle est alors bouclée !

Le forcing de l’IA

À cette dynamique naturelle s’ajoute ce que l’on pourrait appeler le « forcing » de l’IA.

Vous l’avez sans doute remarqué (pour ma part, je le constate au quotidien), des fonctionnalités d’intelligence artificielle ont fait leur apparition dans des dizaines d’applications et de logiciels que l’on utilise tous les jours :

- Gemini s’est glissé dans la suite Google

- Meta AI a débarqué directement dans WhatsApp

- Canva propose systématiquement de s’aider de l’IA pour créer des visuels

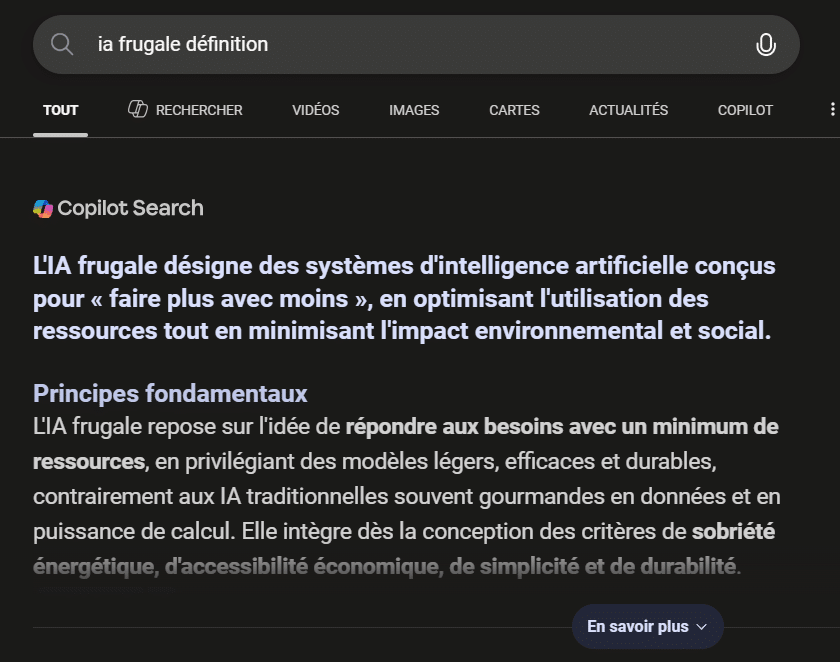

- Copilot nous propose des résumés à chaque recherche sur Bing

- Et bien d’autres encore que j’oublie

Ces éléments sont généralement placés au premier plan des interfaces, signalés par des couleurs vives, et sont quasiment impossibles à désactiver.

Par exemple, Bing me propose systématiquement un résumé créé par l’IA Copilot lors de mes recherches.

Ce « forcing », en plus d’être passablement exaspérant, cache une vraie stratégie. Il sert à déclencher un usage massif afin de justifier les investissements consentis par les grandes entreprises technologiques. La conséquence directe est une hausse de la consommation mondiale énergétique et en eau !

La puissance des centres de données et des puces augmente drastiquement

Dans cette partie, on va parler chiffres !

La puissance des puces augmente

Pour commencer, visualisez votre bon vieux grille-pain. Un tel appareil délivre une puissance d’environ 1000 watts à l’usage.

Sachez que la puce Nvidia Rubin, dernière génération des processeurs graphiques dédiés à l’IA, prévue pour fin 2026, fait à peu près la taille d’un timbre-poste.

Cette puce affiche une puissance de 2 300 watts (soit plus de deux fois plus de puissance que votre grille-pain). Dans un data center consacré à l’IA, on en compte des dizaines de milliers, fonctionnant en permanence.

L’ère des mégas data centers

Cette montée en puissance des puces graphiques se retrouve à l’échelle des infrastructures tout entières. Le projet Stargate d’OpenAI, le méga-data center annoncé aux États-Unis, affiche une puissance totale de 10 gigawatts.

A titre de comparaison, L’EPR de Flamanville, dont la mise en service a mobilisé l’attention médiatique pendant des années, produit 1,6 GW. Autrement dit, un seul projet de data center dédié à l’IA représente l’équivalent de plus de six réacteurs nucléaires de Flamanville.

D’après les projections du Shift Project, la consommation électrique mondiale des serveurs dédiés à l’IA devrait passer d’environ 100 TWh en 2024 à près de 800 TWh en 2030. Les émissions de gaz à effet de serre associées progresseraient dans le même temps de 50 à 250 MtCO2eq.

Source : Shift Project : « Intelligence artificielle, données, calculs : quelles infrastructures dans un monde décarboné ? »

Ces chiffres doivent être mis en regard des objectifs climatiques français. Le scénario tendanciel de l’ADEME/ARCEP, établi avant l’émergence de l’IA générative, tablait sur une réduction de 45 % de l’empreinte carbone du numérique d’ici 2030, conformément à la Stratégie Nationale Bas Carbone. Ces objectifs ne seront jamais atteints.

L’IA frugale en réponse aux impacts environnementaux de l’IA.

Face au constat d’un accroissement de la consommation énergétique et en eau des data centers du fait de l’utilisation massive de l’IA générative, le concept d’IA frugale prend tout son sens ! Explications.

Qu’est-ce que l’IA frugale ?

L’IA frugale est une démarche structurée, outillée, et désormais encadrée par un référentiel officiel. Avant d’aller plus loin, posons clairement sa définition.

Selon l’AFNOR, qui a co-piloté avec le Commissariat Général au Développement Durable la rédaction du premier référentiel mondial dédié au sujet, l’IA frugale vise à réduire globalement les besoins en ressources matérielles et énergétiques et les impacts environnementaux associés aux systèmes d’intelligence artificielle, tout en questionnant les usages pour rester dans les limites planétaires.

L’IA frugale adresse trois composantes complémentaires.

1. La conception des systèmes.

Un projet d’IA frugal interroge le besoin de recourir à l’IA pour répondre à un besoin précis. Un algorithme statistique classique, un modèle de machine learning léger, voire un tableur bien structuré peut parfois produire un résultat équivalent avec une fraction des ressources mobilisées par un grand modèle de langage.

2. La finalité des usages

L’IA frugale interroge aussi le sens de l’usage. Est-ce que l’impact environnemental généré est compensé par les bénéfices réels apportés à l’organisation, à la société ou à l’environnement ?

3. Les effets rebonds

Un modèle rendu plus efficient peut inciter à une multiplication des usages, annulant au passage les gains initialement obtenus. Une démarche d’IA frugale sérieuse intègre ce risque dès la phase de conception.

Des principes au cœur du référentiel général pour l’IA frugale

En juin 2024, la France a publié le Référentiel général pour l’IA frugale, sous la référence AFNOR SPEC 2314. C’est le premier document de ce type au monde entièrement consacré à l’impact environnemental de l’intelligence artificielle.

Il a été élaboré en six mois par un groupe de travail de 150 contributeurs piloté par l’Ecolab du CGDD en partenariat avec l’AFNOR, dans le cadre de la Stratégie Nationale pour l’IA.

Un exemple concret d’usage : le centre d’appel opérationnel des pompiers du Doubs

Pour vous donner une application d’AI Frugale dans la réalité, prenons l’exemple des sapeurs-pompiers du Doubs, qui nous est proposé dans cette vidéo de France 3 Bourgogne Franche Comté :

Depuis 2021, le Service Départemental d’Incendie et de Secours du Doubs (SDIS 25) utilise au quotidien un outil baptisé PrédictOps. Développé en partenariat avec le laboratoire de recherche public Femto-ST de l’université de Franche-Comté, ce logiciel d’intelligence artificielle prédit le nombre d’appels téléphoniques attendus dans les douze heures à venir.

Ce qui rend PrédictOps particulièrement intéressant du point de vue de l’IA frugale, c’est sa sobriété. PrédictOps ne se base pas sur un grand modèle de langage, ni sur de l’IA générative. L’outil repose sur du machine learning ciblé, entraîné sur des données pertinentes, pour répondre à un besoin précis et démontré.

4 bonnes pratiques pour une IA plus frugale au quotidien

Voici quatre bonnes pratiques à suivre pour une utilisation plus frugale de l’IA dans votre travail et au quotidien.

1. Choisir le modèle d’IA adapté à vos besoins

Le choix du modèle d’IA que vous utilisez au quotidien a un impact environnemental considérable.

Pour s’en convaincre, un outil fait référence : EcoLogits, le calculateur développé par Hugging Face, qui permet d’estimer l’empreinte carbone d’une conversation selon le modèle utilisé.

Pour une conversation de 400 tokens générés :

- OpenAI GPT-4 émet environ 3,18 grammes équivalent CO2.

- Mistral Large, pour la même tâche, en émet 13 milligrammes.

L’écart entre les deux atteint un facteur 244 !

Chez Google, la différence entre Gemini 2.5 Pro et Gemini 2.0 Flash dépasse un facteur 11.

Ces chiffres soulèvent une interrogation : utilisez-vous systématiquement le modèle le plus puissant du marché, alors qu’un modèle plus léger ferait parfaitement l’affaire pour la majorité de vos tâches ?

Car c’est bien là le cœur du sujet. Un modèle plus petit, avec moins de paramètres, consomme moins de ressources de calcul et donc moins d’énergie.

Par ailleurs, une éventuelle différence de performance peut très souvent être compensée par un meilleur prompt engineering, c’est-à-dire une meilleure formulation de sa demande avec plus de précision et de contexte permet d’obtenir d’un modèle modeste des résultats comparables à ceux d’un modèle beaucoup plus gourmand.

2. Vérifier la localisation des datacenters utilisés

On parle beaucoup de la consommation électrique des data centers.

On parle beaucoup moins de l’origine de cette électricité. C’est pourtant là que se joue une part significative de l’empreinte carbone de l’usage de l’IA.

Le concept à retenir ici est celui d’intensité carbone. Il désigne la quantité de CO2 émise pour produire un kilowattheure d’électricité. Selon les pays, cet indicateur varie dans des proportions considérables.

En France, grâce à un mix énergétique majoritairement nucléaire, l’intensité carbone du réseau électrique tourne autour de 24 grammes de CO2 par kilowattheure. En Pologne ou en Allemagne, où le charbon et le gaz occupent encore une place importante dans le mix, ce chiffre peut être dix à vingt fois supérieur.

Autrement dit : faire tourner le même modèle d’IA, avec la même quantité de données, sur un data center en France ou sur un data center en Irlande (où sont hébergés de nombreux services cloud américains) ne produit pas du tout le même bilan carbone.

C’est pourquoi privilégier des modèles d’IA hébergés en France, comme Le Chat de Mistral AI par exemple, est une décision à la fois cohérente sur le plan environnemental et pertinente sur le plan de la souveraineté numérique.

3. Limiter le nombre de requêtes à l’IA

Une requête adressée à un modèle d’IA mobilise des ressources de calcul et consomme de l’électricité. Moins vous en envoyez, moins vous consommez.

Si cela peut sembler logique, le problème est que la plupart des utilisateurs d’IA ont pris de mauvaises habitudes et envoient plus de messages qu’il n’en faudrait pour bien délimiter le besoin pour lequel ils ont fait appel à l’AI.

Trois réflexes simples permettent de réduire significativement le nombre de requêtes.

- La précision. Une question bien posée dès le départ évite les reformulations à répétition. Par exemple, il y a une immense différence de précision entre « Parle-moi de l’IA frugale » avec « Explique-moi en cinq points les bénéfices de l’IA frugale pour une PME industrielle, en moins de 300 mots »

- Le regroupement des tâches. Plutôt que d’envoyer trois requêtes successives pour trois questions distinctes, regroupez-les en une seule. Les modèles d’IA actuels gèrent très bien les demandes multiples formulées dans un même message.

- Le prompt engineering, c’est-à-dire la manière de formuler sa demande. Il existe deux techniques à retenir. Le few-shot prompting consiste à fournir au modèle des exemples concrets de ce que vous attendez, ce qui réduit les échanges correctifs. Le chain-of-thought prompting guide le modèle en lui demandant de raisonner étape par étape, ce qui améliore la qualité des réponses complexes dès la première tentative.

4. Limiter l’impact des requêtes

Une fois que vous avez réduit le nombre de requêtes, vous pouvez aussi penser à en réduire l’impact.

Pour cela, on pourrait penser intuitivement que raccourcir la longueur de son prompt est un geste efficace. Pourtant, les données disponibles indiquent le contraire. La taille du prompt en entrée a en fait une influence très faible sur la consommation de ressources du modèle.

En revanche, limiter la longueur des réponses attendues produit un effet mesurable et immédiat. Plus la réponse générée est longue, plus le modèle mobilise de ressources de calcul pour la produire. Spécifier explicitement dans votre requête le format et la longueur souhaitée « en cinq lignes maximum », « sous forme de trois points synthétiques », « en un seul paragraphe » réduit à la fois l’empreinte de la requête et le temps passé à exploiter la réponse.

L’autre paramètre à prendre en compte est la nature des tâches que vous confiez à l’IA. Toutes les requêtes ne se valent pas sur le plan énergétique. Générer une image via un modèle d’IA coûte environ dix fois plus qu’une requête textuelle de complexité équivalente. La génération de vidéos est encore plus énergivore. Avant de solliciter ces fonctionnalités, il vaut la peine de se demander si des alternatives existent : une banque d’images libres de droits, une illustration maison, une photographie réalisée en interne.