En 2026, l’IA occupe une part importante de l’empreinte carbone du numérique.

Elle consomme d’immense quantités d’électricité et d’eau pour faire tourner les data centers dont elle a besoin pour s’entraîner et répondre aux milliards de requêtes auxquelles elle fait face, et nécessite toujours plus de minerais extraits dans des conditions de travail déplorables pour pouvoir construire les processeurs qui lui sont indispensables.

Face à ce constat, la notion de Green AI émerge pour tenter de limiter la course à la puissance à tout prix de l’IA, et d’y intégrer la prise en compte de critères environnementaux.

Découvrez les enjeux du Numérique Responsable en 2026 !

Accédez gratuitement à notre livre blanc : Guide 2026 des bonnes pratiques Numérique Responsable en entreprise

La consommation de l’IA : Un problème écologique majeur

Pour comprendre l’alternative que représente le Green AI, il nous faut dans un premier temps nous intéresser à la problématique écologique centrale liée à la consommation de l’IA. Celle-ci se décline en trois points :

- La consommation énergétique de l’IA

- La consommation en eau de l’IA

- La consommation en minerais de l’AI.

La consommation en énergie de l’IA, une part importante de l’empreinte carbone du numérique

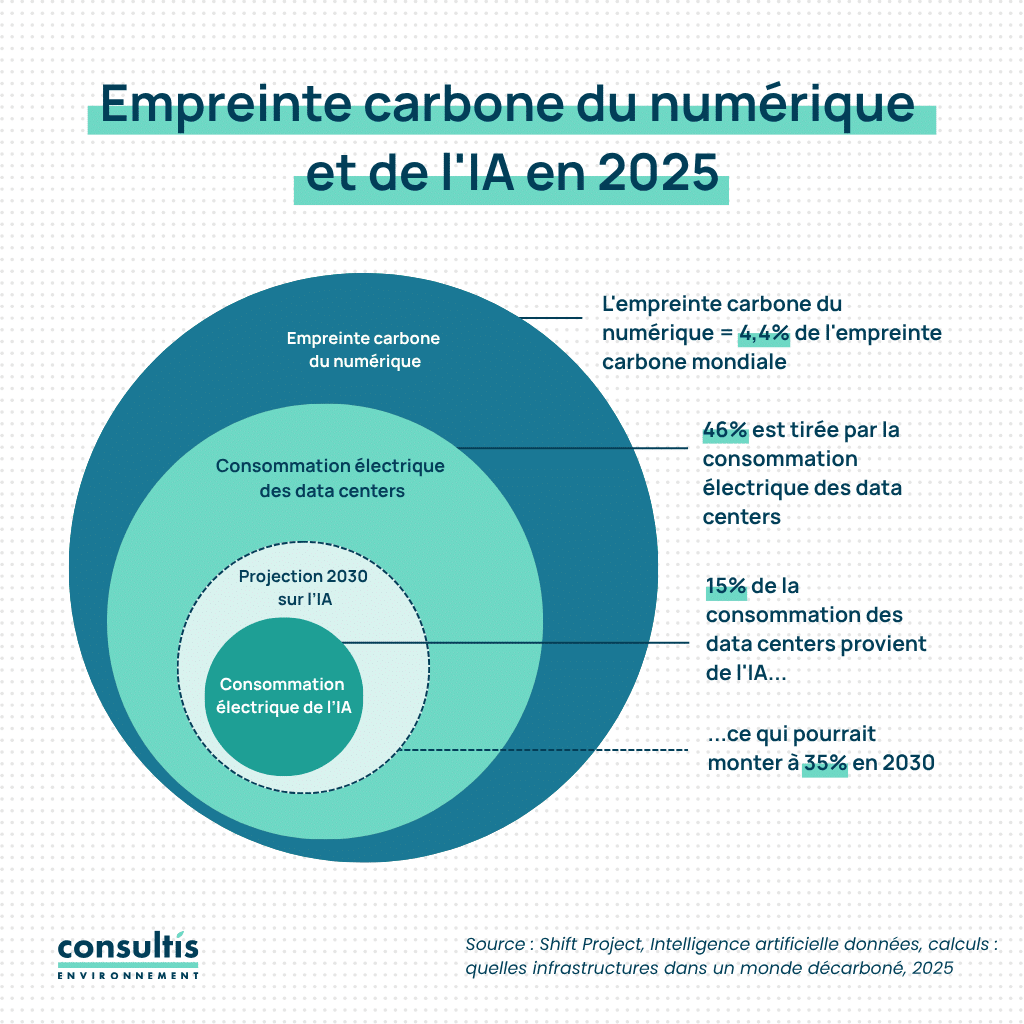

L’étude ADEME ARCEP publiée en janvier 2025 : « Pour un numérique soutenable », montre que le numérique couvre désormais 4,4% de l’empreinte carbone nationale, soit 29,5 millions de tonnes de CO₂ équivalent. Cette part, qui devrait s’accroître dans les prochaines années, est aujourd’hui comparable à la consommation carbone de l’ensemble des poids lourds circulant sur le territoire français pendant l’année.

Lorsqu’on entre en détail dans l’empreinte carbone du numérique, on observe que les data centers (ou centres de données) concentrent à eux seuls 46% de cette empreinte (selon une étude de Research Gate).

Il faut aussi noter que 53% de l’empreinte carbone française liée au numérique est hébergée à l’étranger, ce qui sollicite généralement des infrastructures au mix énergétique moins sobre en énergie que celles hébergées en France.

🙌 Remarque

La France bénéficie d’une électricité bas carbonée, du fait de la prééminence du nucléaire dans son mix énergétique, lui conférant une source d’énergie « propre », à l’inverse de certains de ses homologues européens, comme la Pologne, qui repose encore en partie sur des énergies fossiles comme le charbon par exemple (à 60%).

Ce sont les grands modèles de langage, ces fameux LLMs (Chat GPT, Gemini, Claude, Le Chat, et autres), qui tirent cette consommation vers le haut pour deux raisons :

- D’abord, leur entraînement mobilise des milliers de processeurs graphiques (GPU) pendant des semaines, voire des mois. Par exemple, l’entraînement du modèle Llama 3.1 de Meta aurait généré près de 9 000 tonnes de CO₂, soit l’équivalent de plusieurs centaines de vols Paris-New York.

- Ensuite, une fois entraîné, le modèle doit répondre à des millions de requêtes par jour, ce qu’on appelle la phase d’inférence. Elle représente désormais la part la plus importante de la consommation courante des data centers.

L’IA pèse aujourd’hui environ 15 % de la consommation électrique mondiale des centres de données. Selon les projections, cette part pourrait dépasser 35 % dès 2030

Source : Shift Project

En 2024, plus de la moitié de la consommation mondiale d’électricité des centres de données était d’origine fossile. Les engagements pris par les grands acteurs technologiques sur les énergies renouvelables peinent à suivre le rythme de la croissance de leurs besoins. Google a vu ses émissions de gaz à effet de serre bondir de 48 % par rapport à 2019, Microsoft de 30 % par rapport à 2020.

L’IA est excessivement gourmande en eau

Il existe un autre impact, tout aussi préoccupant : celui de la consommation en eau liée à l’IA.

Explications.

Les serveurs qui font tourner les modèles d’IA génèrent une chaleur considérable. Pour éviter la surchauffe et maintenir des conditions de fonctionnement optimales, les data centers ont massivement recours à des systèmes de refroidissement qui mobilisent d’énormes volumes d’eau.

🙌 Note

Une installation de 10 mégawatts utilisant un refroidissement classique par évaporation peut engloutir près de 90 000 m³ d’eau par an, soit l’équivalent de la consommation annuelle de plusieurs centaines de foyers.

D’après l’Agence internationale de l’énergie dans son rapport Energy and AI d’avril 2025, la consommation totale des data centers a ainsi atteint 560 milliards de litres d’eau en 2023. L’institution anticipe par ailleurs un doublement de ce volume d’ici 2030, avec une projection à 1 200 milliards de litres par an.

Il faut d’ailleurs préciser que, contrairement à l’agriculture, dont l’empreinte hydrique est en grande partie constituée d’eau de pluie absorbée naturellement par les cultures, l’empreinte de l’IA est majoritairement « bleue », c’est-à-dire de l’eau prélevée directement dans des rivières, des lacs ou des nappes phréatiques.

🙌 Remarque

La consommation d’eau ne se limite pas au refroidissement des serveurs. Selon l’AIE :

- 373 milliards de litres servent au refroidissement des data centers

- 140 milliards à la production d’électricité nécessaire à leur fonctionnement

- 47 milliards à la fabrication du matériel informatique.

Face à cet enjeu de consommation d’eau, quelques acteurs commencent à s’engager sur des objectifs chiffrés. Microsoft s’est fixé l’ambition de devenir « water positive » d’ici 2030, c’est-à-dire de restituer davantage d’eau aux écosystèmes locaux qu’elle n’en consomme. Des technologies alternatives existent et progressent, le refroidissement par immersion des serveurs pourrait par exemple réduire la consommation d’eau directe de plus de 80 %, mais leur déploiement à grande échelle reste encore très marginal au regard de la croissance effrénée des besoins.

Une consommation en minerais de l’IA qui pose problème

Les infrastructures nécessaires au fonctionnement de l’IA mobilisent une grande diversité de minerais qui sont utiles pour différents composants.

Les principaux minerais utilisés

Les puces graphiques (GPU) et les processeurs spécialisés (TPU) qui portent les calculs d’entraînement des modèles reposent sur du silicium, du cuivre, du tungstène et du cobalt, indispensables aux interconnexions internes des circuits.

Pour les soudures et les connecteurs, on utilise généralement l’or, l’argent et l’étain, des métaux précieux que l’on retrouve en quantités infinitésimales dans chaque serveur, mais qui, multipliés par les millions de machines déployées dans les data centers du monde entier, représentent des volumes considérables.

Les terres rares sont les matériaux les plus critiques. Parmi eux, le néodyme, le dysprosium et le terbium sont notamment utilisés pour les aimants de haute précision intégrés dans les composants des serveurs. Ces éléments ne sont pas rares au sens géologique du terme mais leur extraction et leur raffinage sont des opérations complexes, coûteuses et particulièrement polluantes.

Les risques liés à l’exploitation intensive de minerais pour l’IA

Un risque de dépendance géopolitique.

La Chine contrôle aujourd’hui plus de 80 % de la production mondiale de terres rares, 98 % du gallium et 93 % des aimants permanents à base de terres rares. Cette concentration confère à Pékin un levier stratégique sur l’ensemble de la chaîne de valeur des technologies numériques.

Un risque de pénurie physique.

L’Agence internationale de l’énergie prévoit que les projets miniers actuels et prévus ne répondront qu’à 80 % des besoins en cuivre d’ici 2030. La demande mondiale en terres rares, portée par l’IA, la robotique et la transition énergétique, suit une trajectoire similaire. Selon Bank of America, la demande d’aimants en néodyme devrait croître à un rythme annuel d’environ 9 % jusqu’en 2035, avec une multiplication par cinq aux États-Unis sur la même période. La demande mondiale en minerais et métaux critiques devrait au moins doubler d’ici 2050, sous l’effet conjugué de l’électrification des usages et de la multiplication des équipements numériques.

Un risque éthique et social

Les mines de la République démocratique du Congo, qui produisent une part importante du tantale, du cuivre et du cobalt nécessaires aux équipements numériques, sont le théâtre de conditions de travail dévastatrices, impliquant notamment du travail d’enfants dans les mines artisanales de cobalt. En Birmanie, des entreprises chinoises exploitent illégalement des gisements de dysprosium et de néodyme sur les terres collectives des peuples Kachin, dévastant des forêts primaires et des écosystèmes jusqu’alors préservés.

Ces deux exemples ne sont pas des cas isolés. L’exploitation intensive de minerais a des conséquences délétères sur les conditions de travail des pays du Sud global qu’il faut à tout prix réguler.

Le Green AI et l’AI for Green face aux dérives de l’IA

Deux logiques ont émergé pour tenter de concilier le développement de l’IA avec la notion de responsabilité environnementale :

- le Green AI, qui vise à rendre l’IA elle-même plus sobre

- l’AI for Green, qui mobilise les capacités de l’IA pour accélérer la transition écologique.

Green AI : intégrer la durabilité au cœur de l’IA

Tout commence par un article académique publié en juillet 2019, signé par Roy Schwartz et ses collègues de l’Allen Institute for AI et de l’Université de Washington. Schwartz y oppose deux philosophies radicalement différentes de la recherche en IA.

La première, qu’il baptise Red AI, est celle qui domine encore largement aujourd’hui : obtenir les meilleures performances possibles en utilisant autant de puissance de calcul que nécessaire, sans jamais rendre compte des coûts environnementaux ou financiers que cela suppose.

La seconde, le Green AI, cherche à rendre l’IA à la fois plus verte et plus inclusive en permettant à quiconque disposant d’un ordinateur portable de produire des recherches de qualité, et en proposant de rendre compte du coût financier et environnemental du développement et de l’entraînement des modèles.

Le Green AI constitue donc un changement de paradigme scientifique qui remet en cause la manière dont on mesure le « progrès » en intelligence artificielle.

5 bonnes pratiques liées au Green AI

La notion de Green AI s’accompagne d’une série de bonnes pratiques pour une IA plus durable :

La réduction de la taille des modèles et le pruning constituent les premières pistes d’optimisation. Le pruning (pour « élagage » en français) consiste à identifier et supprimer les connexions ou les neurones du réseau qui contribuent peu aux résultats finaux. Un modèle élagué peut ainsi se révéler nettement moins énergivore à l’inférence, sans dégradation significative de ses résultats.

La distillation de modèles va plus loin : il s’agit de transférer le « savoir » d’un grand modèle vers un modèle plus compact, appelé modèle élève.

La quantification est une autre technique : elle consiste à réduire la précision numérique des paramètres du modèle pour alléger considérablement les calculs sans sacrifier l’essentiel de la précision.

Le recours à des modèles spécialisés plutôt qu’à des modèles généralistes surdimensionnés représente également un levier sous-exploité en entreprise. Un modèle entraîné sur un domaine précis sera invariablement plus léger et plus pertinent qu’un LLM généraliste sollicité pour des tâches qui n’exploitent qu’une infime partie de ses capacités.

L’optimisation des infrastructures peut aussi jouer un rôle décisif. Les GPU de dernière génération, comme les modèles A100 de NVIDIA, permettent de réduire le temps d’entraînement de près de 60 % par rapport aux générations précédentes, tout en diminuant les émissions de CO₂ de manière significative.

Ce qu’il faut retenir, c’est que le Green AI ne demande pas aux entreprises de renoncer à l’IA. Il leur demande de la pratiquer avec discernement en choisissant le bon outil pour le bon besoin, en mesurant ce qu’elles consomment, et en intégrant l’efficacité énergétique comme critère de choix au même titre que la performance ou le coût.

Avec Consultis Environnement, engagez une démarche de Green AI intégrée à votre stratégie numérique responsable

Les limites du Green AI

Le Green AI présente trois limites structurelles qui en tempèrent considérablement la portée.

D’abord, il faut pointer un certain manque de transparence au niveau des émissions des entreprises de l’AI. Pour mesurer les progrès, il faut des données fiables, or, aucune obligation légale n’impose aujourd’hui aux développeurs d’IA de publier un bilan environnemental complet et vérifiable. L’ADEME elle-même peine à évaluer l’empreinte réelle du secteur faute d’accès aux données des entreprises.

Ensuite, le cadre réglementaire est encore trop timide ; L’AI Act européen, entré en vigueur en août 2024, constitue une avancée historique mais il a été conçu avant tout pour encadrer les risques liés à la sécurité et aux droits fondamentaux.

Enfin, l’effet rebond constitue une troisième grande limite. En effet, les gains d’efficacité rendent l’IA moins coûteuse à utiliser, ce qui démultiplie les usages et, finalement, accroît la consommation totale.

AI for Green : l’IA au service de la cause environnementale

L’AI for Green renverse la notion de Green AI : sa philosophie est en effet de mobiliser l’IA pour accélérer la transition écologique. Cela se traduit dans plusieurs domaines d’application.

Gestion intelligente de l’énergie

La gestion intelligente de l’énergie figure parmi les cas d’usage les plus matures. Les smart grids pilotés par IA permettent d’équilibrer en temps réel la production et la consommation d’électricité, facilitant l’intégration des énergies renouvelables intermittentes. Par exemple, Google a réduit de 40 % la consommation énergétique de ses data centers en confiant leur gestion thermique à un algorithme de deep learning.

Agriculture de précision

L’agriculture de précision offre un autre terrain fertile. Les systèmes d’irrigation intelligents réduisent la consommation d’eau jusqu’à 30 % tout en augmentant les rendements de 15 %, grâce à l’analyse croisée de données satellitaires, de capteurs au sol et de prévisions météo. Suez a quant à elle économisé 33 millions de m³ d’eau en 2024 grâce à ses algorithmes d’IA.

Prévention des risques naturels

La prévention des risques naturels progresse également. Certains modèles d’IA sont capables d’analyser des données environnementales à grande échelle pour prédire des incendies, inondations ou mouvements de terrain, alertant les autorités bien plus rapidement que les systèmes classiques.

Optimisation logistique

Enfin, l’optimisation logistique réduit concrètement les émissions du transport en minimisant les kilomètres à vide et en rationalisant les itinéraires.

🙌 Remarque

Le bilan net de l’AI for Green est difficile à quantifier rigoureusement. Selon le Capgemini Research Institute, l’IA pourrait réduire de 16 % les émissions mondiales de gaz à effet de serre d’ici 2030. Mais ce potentiel ne se concrétisera que si les gains environnementaux dépassent l’empreinte des infrastructures qui les rendent possibles.

Adopter les pratiques du Green AI en entreprise

Dans cette dernière partie, nous vous proposons 5 axes concrets pour engager une démarche de Green AI structurée et crédible au sein de votre entreprise ou organisation

1. Définir une démarche globale de Green AI

Pour être efficace, la démarche de Green AI doit être pilotée, documentée et inscrite dans une stratégie d’ensemble cohérente avec vos engagements RSE.

Cela suppose d’abord d’établir un état des lieux : quels outils d’IA votre entreprise utilise-t-elle ? Pour quels usages ? Avec quels fournisseurs ?

Le collectif Impact AI recommande une approche en trois temps :

- Comprendre les enjeux dans leur globalité

- Mesurer les émissions de gaz à effet de serre et les autres impacts environnementaux

- Piloter et réduire ces impacts de manière progressive

Une charte interne sur l’usage de l’IA peut compléter ce dispositif : elle définit les critères environnementaux et éthiques qui guideront les choix technologiques, et pose la question que trop peu d’entreprises se posent encore : est-ce que cet usage de l’IA apporte réellement une valeur suffisante pour justifier son impact ?

2. Inclure l’usage de l’IA dans vos bilans carbone

Selon une étude de Capgemini, 42 % des dirigeants ont dû réévaluer leurs objectifs climatiques en raison de l’adoption de l’IA générative, et près de la moitié estiment que leur utilisation de l’IA a entraîné une augmentation de 2,6 % à 4,8 % de leurs émissions de gaz à effet de serre.

Pourtant, dans la grande majorité des bilans carbone réalisés en France, les usages numériques, et a fortiori les usages IA, restent soit absents, soit traités de façon superficielle.

Des outils existent pour amorcer cette mesure : CodeCarbon, Green Algorithms ou encore les APIs de monitoring proposées par les principaux fournisseurs cloud. La méthodologie reste en cours de standardisation, mais l’absence de référentiel parfait ne doit pas servir de prétexte à l’inaction. Comme le formulait Peter Drucker : « You can’t manage what you can’t measure » on ne pilote bien que ce qu’on mesure.

Découvrez comment nous avons accompagné une grande entreprise dans la mise en place de son bilan carbone

4. Sensibiliser et former aux conséquences écologiques de l’usage de l’IA

La sobriété numérique passe avant tout par une prise de conscience collective : distinguer les usages qui nécessitent réellement un LLM coûteux de ceux qui peuvent être traités par des modèles plus légers, limiter les entraînements au strict nécessaire, mettre en place une politique d’archivage et de suppression des données inutiles.

Ces réflexes supposent des formations adaptées aux différents avec des mises en situation concrètes et des repères chiffrés.

5. Prioriser les modèles les moins gourmands au sein de votre entreprise

Il convient de distinguer les usages qui nécessitent réellement un grand modèle de langage généraliste de ceux qui peuvent être traités par des modèles spécialisés et plus légers, et de limiter l’usage du deep learning en priorisant des approches moins gourmandes en ressources.

En pratique, cela signifie définir une performance acceptable minimale pour chaque cas d’usage, au-delà de laquelle on arrête les optimisations. Les entreprises devront miser sur des gains d’efficacité via des choix d’architecture et des modèles plus compacts, mais surtout sur la sobriété, sans laquelle les effets rebond annuleront les progrès réalisés.

5. Choisir des fournisseurs de cloud et d’infrastructure qui alimentent leurs centres de données avec de l’énergie verte

Le choix de l’infrastructure est l’un des leviers les plus directs sur l’empreinte carbone des usages IA.

Il est recommandé de choisir des fournisseurs de cloud et d’infrastructure qui valorisent leur chaleur fatale et s’approvisionnent en énergie renouvelable, un critère d’achat responsable directement actionnable dans votre politique d’achats.

Le recours au edge computing, qui décentralise les traitements et ne transmet en central que les informations utiles, constitue une alternative intéressante aux grands data centers centralisés, permettant de réduire à la fois la consommation énergétique et la latence.

Enfin, vous pouvez aussi opter pour le choix d’intégrer des exigences environnementales concrètes dans vos appels d’offres technologiques : taux d’énergie renouvelable, PUE (Power Usage Effectiveness), reporting carbone disponible. Ces critères existent, et les fournisseurs qui refusent d’y répondre vous donnent une information précieuse sur leur niveau de maturité.